Stanford AI Index 2025 cho thấy tỷ lệ tổ chức dùng AI tăng từ 55% năm 2023 lên 78% năm 2024. Khi AI phổ biến hơn, nhân viên cũng dễ tự dùng công cụ hơn. Họ có thể dùng tài khoản cá nhân để viết email, tóm tắt tài liệu hoặc phân tích dữ liệu.

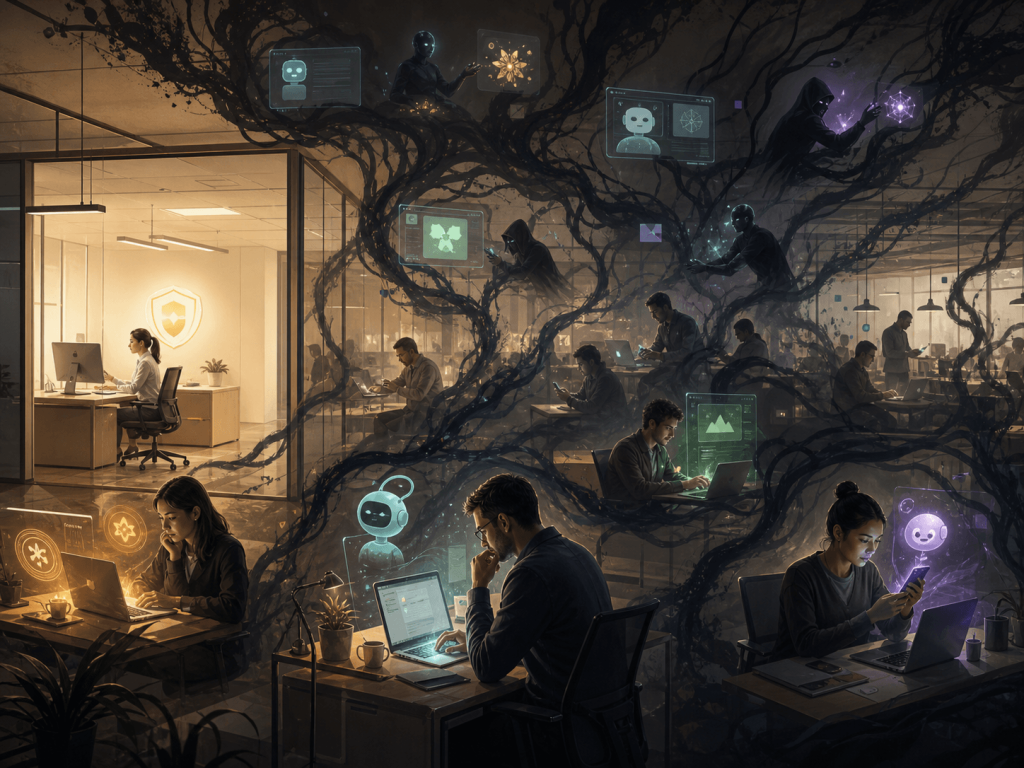

Đây là bối cảnh khiến Shadow AI trở nên đáng lo. Shadow AI là tình trạng nhân viên dùng công cụ AI mà doanh nghiệp không biết hoặc không kiểm soát. Mục đích ban đầu thường là tốt. Nhân viên muốn làm nhanh hơn. Nhưng rủi ro có thể rất lớn.

Shadow AI xuất hiện vì nhu cầu thật

Doanh nghiệp không nên chỉ nhìn Shadow AI như hành vi sai. Nó thường xuất hiện vì nhân viên có nhu cầu thật. Họ cần viết nhanh hơn. Họ cần tóm tắt nhanh hơn. Họ cần xử lý thông tin nhiều hơn. Nếu công ty chưa có giải pháp chính thức, họ sẽ tự tìm công cụ.

Vì vậy, cấm tuyệt đối chưa chắc hiệu quả. Nếu công việc quá tải, nhân viên vẫn có thể dùng ngầm. Khi đó, doanh nghiệp còn khó kiểm soát hơn. Cách tốt hơn là tạo vùng sử dụng an toàn.

Rủi ro lớn nhất là dữ liệu

Nhân viên có thể nhập hợp đồng, báo giá hoặc dữ liệu khách hàng vào AI. Họ không biết công cụ đó lưu dữ liệu ra sao. Họ cũng không biết dữ liệu có được dùng để huấn luyện hay không. Một hành động nhỏ có thể tạo rủi ro lớn.

Dữ liệu nhân sự cũng rất nhạy cảm. CV ứng viên, đánh giá nhân viên và thông tin lương không nên được nhập tùy tiện. Doanh nghiệp cần liệt kê rõ dữ liệu nào bị cấm. Nói chung chung sẽ không đủ.

Rủi ro thứ hai là chất lượng

Nội dung AI tạo có thể sai nhưng nghe rất tự tin. Nếu nhân viên gửi cho khách hàng, hậu quả có thể nghiêm trọng. Ví dụ, email có cam kết sai về thời gian. Hoặc báo cáo có số liệu không có nguồn. Hoặc tài liệu nội bộ có hướng dẫn không đúng.

Vì vậy, Shadow AI không chỉ là rủi ro bảo mật. Nó còn là rủi ro chất lượng. Doanh nghiệp cần quy trình kiểm tra đầu ra AI. Nội dung quan trọng phải có người duyệt.

Cách quản lý Shadow AI

Bước đầu tiên là khảo sát. Hỏi nhân viên đang dùng AI cho việc gì. Họ dùng công cụ nào. Họ thấy lợi ích ở đâu. Họ gặp lỗi nào. Khảo sát không nên mang tính trừng phạt. Mục tiêu là hiểu thực trạng.

Bước thứ hai là xây chính sách một trang. Chính sách cần nói rõ công cụ được phép dùng, dữ liệu bị cấm và nội dung cần duyệt. Bước thứ ba là đào tạo. Nhân viên cần hiểu vì sao quy định tồn tại. Nếu chỉ đưa lệnh cấm, họ sẽ khó tuân thủ.

Cung cấp công cụ chính thức

Nếu có thể, doanh nghiệp nên cung cấp công cụ được phê duyệt. Khi có lựa chọn chính thức, nhân viên ít cần dùng công cụ lạ. Công cụ chính thức cũng giúp IT kiểm soát bảo mật tốt hơn.

Tuy nhiên, công cụ không đủ. Nhân viên vẫn cần được hướng dẫn theo tác vụ. Công cụ này dùng để viết gì. Dữ liệu nào được nhập. Đầu ra nào cần kiểm tra. Khi hướng dẫn rõ, mức độ áp dụng sẽ tốt hơn.

Đừng biến chính sách thành nỗi sợ

Quản lý Shadow AI không nên chỉ là cấm đoán. Nếu chính sách quá nặng, nhân viên sẽ sợ và giấu việc dùng AI. Doanh nghiệp nên giải thích rõ lý do. Mục tiêu là dùng AI an toàn hơn, không phải ngăn cản sáng tạo.

Có thể tạo vùng thử nghiệm an toàn. Trong vùng đó, nhân viên được thử công cụ đã duyệt. Họ được dùng dữ liệu giả hoặc dữ liệu không nhạy cảm. Họ được chia sẻ lỗi để cùng học. Cách này giúp kiểm soát mà không làm tắt động lực.

Kết luận

Shadow AI là rủi ro, nhưng cũng là tín hiệu nhu cầu. Nhân viên đang muốn làm việc nhanh hơn. Doanh nghiệp nên quản lý thay vì chỉ cấm. Chính sách, đào tạo và công cụ chính thức là ba bước cần làm.

HVCG có thể hỗ trợ doanh nghiệp khảo sát Shadow AI, xây chính sách sử dụng và đào tạo nhân viên dùng AI an toàn trong công việc hằng ngày